Trí tuệ nhân tạo. Phần thứ hai: Tuyệt chủng hay bất tử?

Đây là phần thứ hai của bài viết trong loạt bài "Đợi đã, làm sao tất cả những điều này có thể là sự thật, tại sao nó vẫn chưa được nói đến trên mọi ngóc ngách." Trong loạt phim trước, người ta đã biết rằng sự bùng nổ trí thông minh đang dần len lỏi vào con người trên hành tinh Trái đất, nó đang cố gắng phát triển từ trí thông minh tập trung hẹp sang trí thông minh phổ quát của con người và cuối cùng là siêu trí tuệ nhân tạo.

Phần đầu tiên của bài báo bắt đầu khá ngây thơ. Chúng ta đã thảo luận về trí tuệ nhân tạo tập trung hẹp (AI, chuyên giải quyết một nhiệm vụ cụ thể như xác định lộ trình hoặc chơi cờ), trong thế giới của chúng ta có rất nhiều loại trí tuệ nhân tạo. Sau đó, chúng tôi đã phân tích lý do tại sao rất khó để phát triển trí tuệ nhân tạo đa năng (GAI hoặc AI, về khả năng trí tuệ có thể được so sánh với một người trong việc giải quyết bất kỳ vấn đề nào) từ AII. Chúng tôi kết luận rằng tốc độ tiến bộ công nghệ theo cấp số nhân gợi ý rằng AGI có thể sẽ sớm ra mắt. Cuối cùng, chúng tôi quyết định rằng một khi máy móc đạt đến mức độ thông minh của con người, những điều sau đây có thể xảy ra ngay lập tức:

Như thường lệ, chúng tôi nhìn vào màn hình, không tin rằng siêu trí tuệ nhân tạo (AI, thông minh hơn nhiều so với bất kỳ người nào) có thể xuất hiện trong cuộc đời của chúng tôi và chọn những cảm xúc phản ánh đúng nhất quan điểm của chúng tôi về vấn đề này.

Trước khi đi sâu vào các chi tiết cụ thể của ASI, chúng ta hãy tự nhắc lại ý nghĩa của việc một cỗ máy trở nên siêu thông minh.

Sự khác biệt chính nằm giữa siêu trí tuệ nhanh và siêu trí tuệ định tính. Thông thường, điều đầu tiên xuất hiện trong đầu khi nghĩ về một chiếc máy tính siêu thông minh là nó có thể suy nghĩ nhanh hơn con người rất nhiều - nhanh hơn hàng triệu lần và trong năm phút, con người có thể hiểu được những gì mà một người phải mất mười năm mới làm được. ("Tôi biết kung fu!")

Nghe có vẻ ấn tượng và ASI thực sự nên suy nghĩ nhanh hơn bất kỳ ai trong số mọi người - nhưng đặc điểm khác biệt chính sẽ là chất lượng trí thông minh của nó, một điều hoàn toàn khác. Con người thông minh hơn nhiều so với khỉ, không phải vì họ suy nghĩ nhanh hơn, mà vì bộ não con người chứa một số mô-đun nhận thức khéo léo thực hiện các biểu diễn ngôn ngữ phức tạp, lập kế hoạch dài hạn, tư duy trừu tượng, điều mà loài khỉ không có khả năng. Nếu bạn ép xung bộ não của một con khỉ hàng nghìn lần, nó sẽ không trở nên thông minh hơn chúng ta - thậm chí trong mười năm, nó sẽ không thể lắp ráp bộ thiết kế theo hướng dẫn, điều này sẽ khiến một người mất tối đa vài giờ. Có những thứ mà một con khỉ sẽ không bao giờ học được, cho dù nó có bỏ ra bao nhiêu giờ hay bộ não của nó hoạt động nhanh đến đâu.

Ngoài ra, con khỉ không biết làm người, bởi vì bộ não của nó đơn giản là không thể nhận ra sự tồn tại của các thế giới khác - con khỉ có thể biết con người là gì và tòa nhà chọc trời là gì, nhưng sẽ không bao giờ hiểu rằng tòa nhà chọc trời là gì do con người xây dựng. Trong thế giới của cô ấy, mọi thứ đều thuộc về tự nhiên và chú khỉ không những không thể xây dựng một tòa nhà chọc trời mà còn hiểu rằng bất kỳ ai cũng có thể xây dựng được nó. Và đây là kết quả của một sự khác biệt nhỏ về chất lượng của trí thông minh.

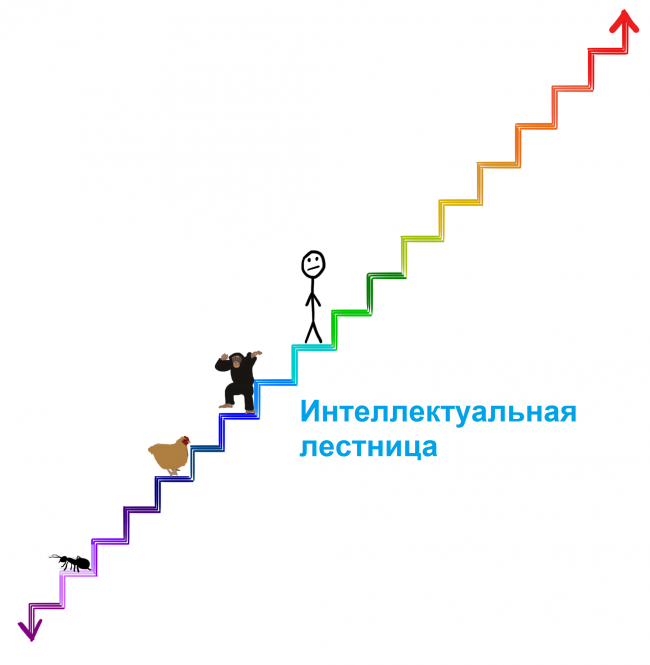

Trong sơ đồ chung về trí thông minh mà chúng ta đang nói đến, hay đơn giản là theo tiêu chuẩn của các sinh vật sinh học, sự khác biệt về chất lượng trí thông minh của loài người và vượn là rất nhỏ. Trong bài viết trước, chúng tôi đã đặt nhận thức sinh học trên một bậc thang:

Để hiểu mức độ nghiêm trọng của một cỗ máy siêu thông minh, hãy đặt nó cao hơn con người hai bậc trên chiếc thang này. Cỗ máy này có thể hơi siêu thông minh, nhưng ưu thế của nó so với khả năng nhận thức của chúng ta cũng giống như ưu thế của chúng ta đối với loài khỉ. Và giống như một con tinh tinh không bao giờ có thể hiểu được rằng có thể xây dựng một tòa nhà chọc trời, chúng ta có thể không bao giờ hiểu được một cỗ máy cao hơn vài bước sẽ hiểu điều gì, ngay cả khi cỗ máy đó cố gắng giải thích điều đó cho chúng ta. Và nó chỉ là một vài bước. Một cỗ máy thông minh hơn sẽ coi chúng ta như những con kiến - nó sẽ dạy chúng ta những điều đơn giản nhất trong nhiều năm từ vị trí của nó, và những nỗ lực này sẽ hoàn toàn vô vọng.

Loại siêu trí tuệ mà chúng ta sắp nói đến ngày hôm nay nằm ngoài bậc thang đó. Đây là sự bùng nổ của trí thông minh - khi máy móc càng trở nên thông minh hơn thì nó có thể tăng trí thông minh của chính mình càng nhanh, dần dần tăng dần động lực. Có thể mất nhiều năm để một cỗ máy như vậy vượt qua tinh tinh về trí thông minh, nhưng có lẽ vài giờ để đánh bại chúng ta một hoặc hai bước. Kể từ thời điểm này, chiếc xe đã có thể nhảy qua bốn bước mỗi giây. Đó là lý do tại sao chúng ta nên hiểu rằng ngay sau lần đầu tiên tin tức rằng cỗ máy đã đạt đến trình độ thông minh của con người, chúng ta có thể phải đối mặt với thực tế cùng tồn tại trên Trái đất với thứ gì đó sẽ cao hơn chúng ta rất nhiều trên nấc thang này (có thể cao hơn hàng triệu lần):

Và vì chúng ta đã xác định rằng việc cố gắng hiểu sức mạnh của một cỗ máy chỉ hơn chúng ta hai bậc là hoàn toàn vô ích, hãy xác định một lần dứt điểm rằng không có cách nào để hiểu ASI sẽ làm gì và hậu quả của nó là gì. cái này sẽ dành cho chúng ta. Bất cứ ai tuyên bố khác chỉ đơn giản là không hiểu siêu trí tuệ nghĩa là gì.

Sự tiến hóa đã phát triển bộ não sinh học một cách từ từ và dần dần qua hàng trăm triệu năm, và nếu con người tạo ra một cỗ máy siêu thông minh, thì ở một khía cạnh nào đó, chúng ta sẽ vượt qua sự tiến hóa. Hoặc nó sẽ là một phần của quá trình tiến hóa - có lẽ cách thức hoạt động của quá trình tiến hóa là trí thông minh phát triển dần dần cho đến khi đạt đến điểm bùng phát báo trước một tương lai mới cho mọi sinh vật:

Vì những lý do mà chúng ta sẽ thảo luận sau, phần lớn cộng đồng khoa học tin rằng câu hỏi không phải là liệu chúng ta có đạt đến điểm bùng phát này hay không, mà là khi nào.

Chúng ta sẽ ở đâu sau chuyện này?

Tôi không nghĩ bất cứ ai trên thế giới này, tôi hay bạn, sẽ có thể biết điều gì sẽ xảy ra khi chúng ta đạt đến điểm bùng phát. Nhà triết học Oxford và nhà lý thuyết AI hàng đầu Nick Bostrom tin rằng chúng ta có thể chia tất cả các kết quả có thể xảy ra thành hai loại lớn.

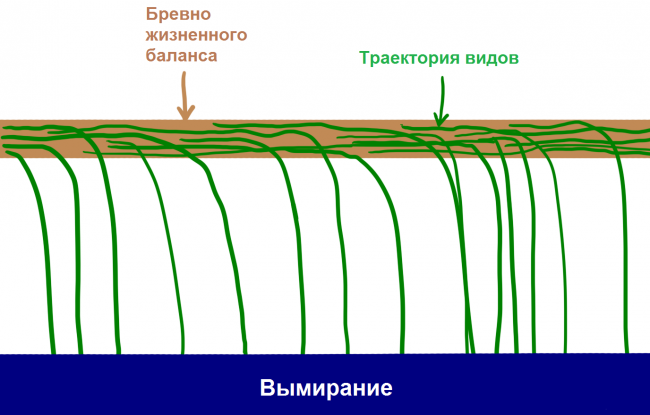

Đầu tiên, nhìn vào câu chuyện, chúng ta biết những điều sau về sự sống: các loài xuất hiện, tồn tại trong một thời gian nhất định, rồi chắc chắn rơi khỏi nhật ký cân bằng sự sống và chết đi.

"Tất cả các loài đều chết" là một quy luật đáng tin cậy trong lịch sử giống như "tất cả con người đều chết vào một lúc nào đó." 99,9% các loài đã rơi khỏi khúc gỗ sự sống, và rõ ràng là nếu một loài ở trên khúc gỗ này quá lâu, một cơn gió tự nhiên hoặc một thiên thạch bất ngờ sẽ lật đổ khúc gỗ đó. Bostrom gọi sự tuyệt chủng là một trạng thái hấp dẫn, một nơi mà tất cả các loài cân bằng để tránh rơi vào một nơi mà từ đó chưa có loài nào quay trở lại.

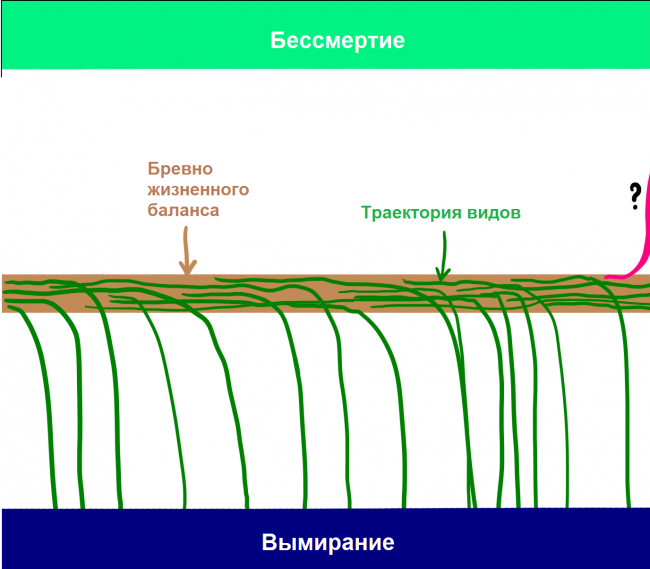

Và trong khi hầu hết các nhà khoa học thừa nhận rằng ASI sẽ có khả năng khiến con người tuyệt chủng, nhiều người cũng tin rằng việc khai thác sức mạnh của ASI sẽ cho phép các cá nhân (và cả loài nói chung) đạt được trạng thái thứ hai của chất hấp dẫn, sự bất tử của loài. . Bostrom tin rằng sự bất tử của một loài cũng giống như một yếu tố thu hút giống như sự tuyệt chủng của các loài, nghĩa là, nếu chúng ta đạt đến điểm đó, chúng ta sẽ phải cam chịu sự tồn tại vĩnh cửu. Do đó, ngay cả khi tất cả các loài cho đến ngày nay đã rơi từ chiếc gậy này xuống vực tuyệt chủng, Bostrom tin rằng khúc gỗ có hai mặt, và đơn giản là không có một trí thông minh nào trên Trái đất hiểu được cách rơi xuống phía bên kia.

Nếu Bostrom và những người khác đúng, và từ tất cả thông tin có sẵn cho chúng ta thì họ rất có thể đúng, chúng ta cần phải chấp nhận hai sự thật rất sốc:

Sự xuất hiện của ASI lần đầu tiên trong lịch sử sẽ mở ra khả năng cho một loài đạt được sự bất tử và thoát khỏi vòng tuyệt chủng chết người.

Sự ra đời của ASI sẽ có tác động to lớn ngoài sức tưởng tượng đến mức rất có thể nó sẽ đẩy nhân loại ra khỏi nhật ký này theo hướng này hay hướng khác.

Rất có thể khi sự tiến hóa đạt đến đỉnh điểm như vậy, nó luôn đặt dấu chấm hết cho mối quan hệ của con người với dòng chảy cuộc sống và tạo ra một thế giới mới, có hoặc không có con người.

Điều này dẫn đến một câu hỏi thú vị mà chỉ những người lười biếng mới không hỏi: khi nào chúng ta sẽ đạt đến điểm bùng phát này và nó sẽ đặt chúng ta ở đâu? Không ai trên thế giới biết câu trả lời cho câu hỏi kép này, nhưng rất nhiều người thông minh đã cố gắng tìm ra nó trong nhiều thập kỷ. Phần còn lại của bài viết, chúng tôi sẽ tìm hiểu những gì họ đã đến.

Hãy bắt đầu với phần đầu tiên của câu hỏi này: khi nào chúng ta nên đạt đến điểm bùng phát? Nói cách khác: còn bao nhiêu thời gian nữa cho đến khi cỗ máy đầu tiên đạt đến siêu trí tuệ?

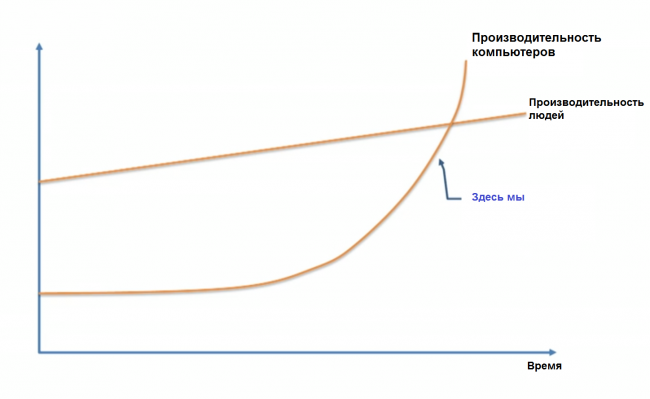

Ý kiến khác nhau tùy theo từng trường hợp. Nhiều người, bao gồm Giáo sư Vernor Vinge, nhà khoa học Ben Goertzel, người đồng sáng lập Sun Microsystems Bill Joy và nhà tương lai học Ray Kurzweil, đã đồng ý với chuyên gia máy học Jeremy Howard khi ông trình bày biểu đồ sau tại TED Talk:

Những người này chia sẻ quan điểm rằng ASI sẽ sớm ra mắt - sự tăng trưởng theo cấp số nhân này, có vẻ chậm đối với chúng ta ngày nay, sẽ bùng nổ theo đúng nghĩa đen trong vài thập kỷ tới.

Những người khác, như nhà đồng sáng lập Microsoft Paul Allen, nhà tâm lý học nghiên cứu Gary Marcus, chuyên gia máy tính Ernest Davis và doanh nhân công nghệ Mitch Kapor, cho rằng những nhà tư tưởng như Kurzweil đang đánh giá thấp nghiêm trọng mức độ nghiêm trọng của vấn đề và cho rằng chúng ta chưa đến mức đỉnh điểm. điểm.

Phe Kurzweil phản bác rằng sự đánh giá thấp duy nhất đang diễn ra là bỏ qua sự tăng trưởng theo cấp số nhân, và những người hoài nghi có thể được so sánh với những người đã nhìn vào sự phát triển chậm chạp của Internet vào năm 1985 và lập luận rằng nó sẽ không có tác động gì đến thế giới trong tương lai gần. .

Những người "nghi ngờ" có thể phản bác rằng tiến bộ khó thực hiện từng bước hơn khi nói đến trí thông minh theo cấp số nhân, điều này loại bỏ bản chất cấp số nhân điển hình của tiến bộ công nghệ. Và như thế.

Phe thứ ba, bao gồm Nick Bostrom, không đồng ý với phe thứ nhất và phe thứ hai, lập luận rằng a) tất cả những điều này hoàn toàn có thể xảy ra trong tương lai gần; và b) không có gì đảm bảo rằng điều này sẽ xảy ra hoặc mất nhiều thời gian hơn.

Những người khác, như nhà triết học Hubert Dreyfus, tin rằng cả ba nhóm này đều tin một cách ngây thơ rằng sẽ có một điểm bùng phát, và rất có thể chúng ta sẽ không bao giờ đạt được ASI.

Điều gì xảy ra khi chúng ta cộng tất cả những ý kiến này lại với nhau?

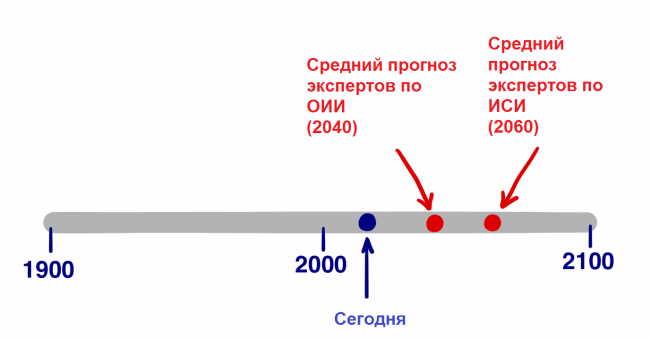

Vào năm 2013, Bostrom đã tiến hành một cuộc thăm dò, trong đó ông đã phỏng vấn hàng trăm chuyên gia trí tuệ nhân tạo trong một loạt hội nghị về chủ đề sau: "Dự đoán của bạn để đạt được AGI ở cấp độ con người là gì?" và yêu cầu một năm lạc quan (trong đó chúng tôi sẽ có AGI với 10% cơ hội), một dự đoán thực tế (một năm mà chúng tôi sẽ có 50% cơ hội có AGI) và một dự đoán chắc chắn (năm sớm nhất mà AGI sẽ xuất hiện với xác suất 90 - phần trăm). Đây là kết quả:

* Năm lạc quan trung bình (10%): 2022

* Năm thực tế trung bình (50%): 2040

* Năm bi quan trung bình (90%): 2075

Những người được hỏi trung bình tin rằng trong 25 năm nữa, chúng ta sẽ có nhiều khả năng mắc AII hơn là không. 90 phần trăm cơ hội mắc AIS vào năm 2075 có nghĩa là nếu bây giờ bạn vẫn còn khá trẻ, điều đó có thể xảy ra trong đời bạn.

Một nghiên cứu riêng biệt gần đây của James Barratt (tác giả của cuốn sách nổi tiếng và rất hay Phát minh mới nhất của chúng ta, trích từ Tôi đã trình bày để bạn đọc chú ý Hi-News.ru) và Ben Herzel tại hội nghị AGI hàng năm, Hội nghị AGI, vừa trình bày ý kiến của mọi người về năm mà chúng ta đạt được AGI: vào năm 2030, 2050, 2100, muộn hơn hoặc không bao giờ. Đây là kết quả:

* 2030: 42% số người được hỏi

* 2050: 25%

* 2100: 20%

Sau năm 2100: 10%

Không bao giờ: 2%

Tương tự với kết quả của Bostrom. Trong cuộc thăm dò của Barratt, hơn hai phần ba số người được hỏi tin rằng AGI sẽ có mặt vào năm 2050 và chưa đến một nửa tin rằng AGI sẽ có mặt trong 15 năm tới. Điều đáng chú ý là chỉ có 2% những người được khảo sát hoàn toàn không nhìn thấy AGI trong tương lai của chúng ta.

Nhưng AGI không phải là công cụ thay đổi cuộc chơi như ASI. Theo các chuyên gia, khi nào chúng ta sẽ có ASI?

Bostrom đã hỏi các chuyên gia khi nào chúng ta sẽ đạt được ASI: a) hai năm sau khi đạt được AIS (nghĩa là gần như ngay lập tức do sự bùng nổ của trí thông minh); b) sau 30 năm. Kết quả?

Ý kiến trung bình cho rằng sự chuyển đổi nhanh chóng từ AGI sang ASI sẽ xảy ra với xác suất 10%, nhưng trong 30 năm hoặc ít hơn nó sẽ xảy ra với xác suất 75%.

Từ dữ liệu này, chúng tôi không biết ngày mà người trả lời sẽ cho là 50% cơ hội ASI, nhưng dựa trên hai câu trả lời ở trên, hãy giả sử đó là 20 năm. Tức là các chuyên gia hàng đầu thế giới trong lĩnh vực AI đều tin rằng bước ngoặt sẽ đến vào năm 2060 (AII sẽ xuất hiện vào năm 2040 + mất 20 năm để chuyển từ AGI sang ASI).

Tất nhiên, tất cả các thống kê trên chỉ là suy đoán và chỉ đại diện cho ý kiến của các chuyên gia AI, nhưng chúng cũng chỉ ra rằng hầu hết những người liên quan đều đồng ý rằng ASI có thể sẽ xuất hiện vào năm 2060. Chỉ 45 năm sau.

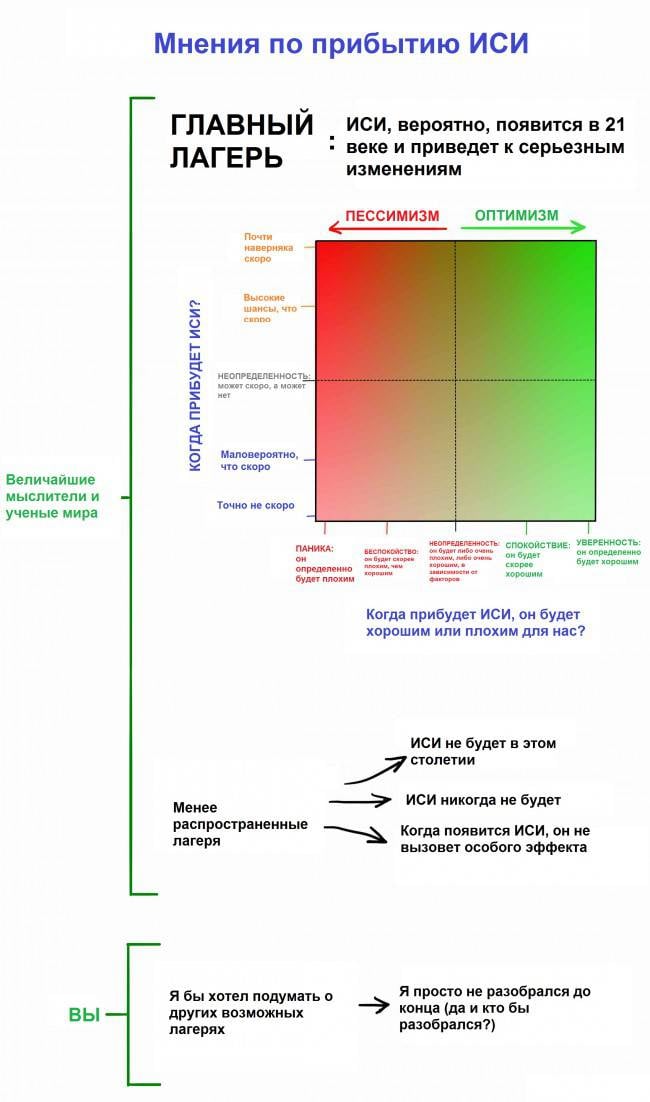

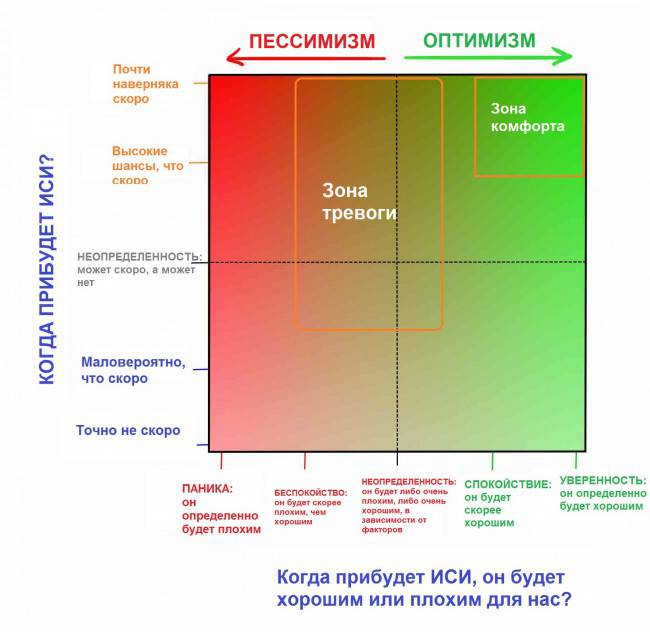

Hãy chuyển sang câu hỏi thứ hai. Khi chúng ta đạt đến điểm bùng phát, chúng ta sẽ quyết định đứng về phía nào của sự lựa chọn định mệnh?

Siêu trí tuệ sẽ có sức mạnh mạnh mẽ nhất, và câu hỏi quan trọng đối với chúng ta sẽ là:

Ai hoặc cái gì sẽ kiểm soát sức mạnh này và động lực của họ là gì?

Câu trả lời cho câu hỏi này sẽ phụ thuộc vào việc liệu ASI có được một sự phát triển cực kỳ mạnh mẽ, một sự phát triển vô cùng đáng sợ hay điều gì đó ở giữa.

Tất nhiên, cộng đồng chuyên gia cũng đang cố gắng trả lời những câu hỏi này. Cuộc thăm dò của Bostrom đã phân tích khả năng xảy ra những hậu quả có thể xảy ra do tác động của AGI đối với nhân loại và nhận thấy rằng với 52% khả năng mọi thứ sẽ diễn ra rất tốt và với 31% khả năng mọi thứ sẽ trở nên tồi tệ hoặc cực kỳ tồi tệ. Cuộc thăm dò được đính kèm ở cuối phần trước của chủ đề này, được thực hiện giữa các bạn, những độc giả thân mến của Hi-News, cho thấy kết quả tương tự. Đối với một kết quả tương đối trung lập, xác suất chỉ là 17%. Nói cách khác, tất cả chúng ta đều nghĩ rằng sự ra đời của AGI sẽ là một vấn đề lớn. Cũng cần lưu ý rằng cuộc khảo sát này nói về sự xuất hiện của AGI - trong trường hợp của ASI, tỷ lệ trung lập sẽ thấp hơn.

Trước khi đi sâu hơn vào khía cạnh tốt và xấu của câu hỏi, chúng ta hãy kết hợp cả hai phần của câu hỏi - "khi nào điều này sẽ xảy ra?" và “nó tốt hay xấu?” thành một bảng bao hàm quan điểm của hầu hết các chuyên gia.

Chúng ta sẽ nói về trại chính trong một phút nữa, nhưng trước tiên hãy quyết định vị trí của bạn. Rất có thể, bạn đang ở cùng một nơi với tôi, trước khi tôi bắt đầu giải quyết chủ đề này. Có một số lý do khiến mọi người không nghĩ về chủ đề này chút nào:

* Như đã đề cập trong phần đầu tiên, các bộ phim khiến con người và sự thật bối rối nghiêm trọng khi đưa ra những viễn cảnh phi thực tế với trí tuệ nhân tạo, dẫn đến việc chúng ta không nên coi trọng AI một chút nào. James Barrat đã so sánh tình huống này với việc Trung tâm Kiểm soát Dịch bệnh đưa ra một cảnh báo nghiêm trọng về ma cà rồng trong tương lai của chúng ta.

* Vì cái gọi là thành kiến nhận thức, chúng ta rất khó tin vào thực tế của một điều gì đó cho đến khi chúng ta có bằng chứng. Người ta có thể tưởng tượng một cách an toàn rằng các nhà khoa học máy tính năm 1988 thường xuyên thảo luận về những tác động sâu rộng của Internet và những gì nó có thể trở thành, nhưng mọi người hầu như không tin rằng nó sẽ thay đổi cuộc sống của họ cho đến khi nó thực sự xảy ra. Chỉ là máy tính không thể làm được điều đó vào năm 1988, và mọi người chỉ nhìn vào máy tính của họ và nghĩ, “Thật sao? Đây có phải là thứ sẽ thay đổi thế giới không?" Trí tưởng tượng của họ bị giới hạn bởi những gì họ đã học được từ kinh nghiệm cá nhân, họ biết máy tính là gì và thật khó để tưởng tượng máy tính sẽ có khả năng gì trong tương lai. Điều tương tự cũng đang xảy ra với AI. Chúng tôi nghe nói rằng nó sẽ trở thành một vấn đề nghiêm trọng, nhưng vì chúng tôi chưa gặp trực tiếp và nhìn chung chúng tôi đang thấy những biểu hiện khá yếu ớt của AI trong thế giới hiện đại của chúng tôi, nên chúng tôi rất khó tin rằng nó sẽ thay đổi mạnh mẽ cuộc sống của chúng ta. Chính những định kiến này mà nhiều chuyên gia từ tất cả các phe, cũng như những người quan tâm, đang phản đối: họ đang cố gắng thu hút sự chú ý của chúng ta thông qua sự ồn ào của chủ nghĩa vị kỷ tập thể hàng ngày.

* Ngay cả khi chúng ta tin vào tất cả những điều này, thì hôm nay đã bao nhiêu lần bạn nghĩ về sự thật rằng bạn sẽ dành phần còn lại của cõi vĩnh hằng trong hư vô? Một chút, đồng ý. Ngay cả khi thực tế này quan trọng hơn nhiều so với bất cứ điều gì bạn làm hàng ngày. Điều này là do bộ não của chúng ta có xu hướng tập trung vào những điều nhỏ nhặt hàng ngày, bất kể tình huống dài hạn mà chúng ta thấy mình đang ở trong đó điên rồ đến mức nào. Đó chỉ là cách chúng ta đang có.

Một trong những mục đích của bài viết này là đưa bạn ra khỏi trại "Tôi thích nghĩ về những thứ khác" và đưa bạn vào trại chuyên gia, ngay cả khi bạn chỉ đang đứng ở ngã ba đường giữa hai đường chấm trong hình vuông. ở trên, hoàn toàn không quyết định.

Trong quá trình nghiên cứu, rõ ràng là ý kiến của hầu hết mọi người nhanh chóng chuyển sang "trại chính" và XNUMX/XNUMX chuyên gia rơi vào hai nhóm nhỏ trong trại chính.

Chúng tôi sẽ thăm cả hai trại này một cách đầy đủ. Hãy bắt đầu với niềm vui.

Tại sao tương lai có thể là giấc mơ lớn nhất của chúng ta?

Khi khám phá thế giới AI, chúng tôi nhận thấy một số lượng đáng ngạc nhiên là có rất nhiều người đang ở trong vùng an toàn của họ. Những người ở quảng trường phía trên bên phải đang xôn xao với sự phấn khích. Họ tin rằng chúng ta sẽ rơi vào mặt tốt của chùm tia, và cũng tin rằng chúng ta chắc chắn sẽ đi đến điều này. Đối với họ, tương lai chỉ là điều tốt nhất mà người ta có thể mơ ước.

Điểm phân biệt những người này với những người có suy nghĩ khác không phải là họ muốn ở bên hạnh phúc, mà là họ chắc chắn rằng chúng ta đang chờ đợi điều đó.

Sự tự tin này đến từ tranh cãi. Các nhà phê bình tin rằng nó xuất phát từ sự phấn khích mù quáng làm lu mờ những tiêu cực tiềm ẩn. Nhưng những người ủng hộ nói rằng những dự báo ảm đạm luôn ngây thơ; công nghệ vẫn tiếp tục và sẽ luôn giúp chúng ta nhiều hơn là làm hại chúng ta.

Bạn có thể tự do lựa chọn bất kỳ ý kiến nào trong số này, nhưng hãy gạt bỏ sự hoài nghi của bạn sang một bên và nhìn kỹ vào mặt tốt của chiếc cân, cố gắng chấp nhận sự thật rằng mọi thứ bạn đọc có thể đã xảy ra. Nếu bạn cho những người săn bắn hái lượm thấy thế giới tiện nghi, công nghệ và sự phong phú vô tận của chúng ta, thì đó sẽ giống như một điều kỳ diệu đối với họ - và chúng ta cư xử đủ khiêm tốn, không thể thừa nhận rằng sự biến đổi khó hiểu tương tự đang chờ đợi chúng ta trong tương lai.

Nick Bostrom mô tả ba con đường mà một hệ thống AI siêu thông minh có thể thực hiện:

* Một nhà tiên tri có thể trả lời bất kỳ câu hỏi rõ ràng nào, kể cả những câu hỏi khó mà con người không thể trả lời, chẳng hạn như "làm thế nào để bạn làm cho động cơ ô tô hoạt động hiệu quả hơn?" Google là một loại "nhà tiên tri" nguyên thủy.

* Một vị thần sẽ thực thi bất kỳ mệnh lệnh cấp cao nào - sử dụng bộ lắp ráp phân tử để tạo ra một phiên bản mới, hiệu quả hơn của động cơ ô tô - và chờ mệnh lệnh tiếp theo.

* Một chủ quyền sẽ có quyền truy cập rộng rãi và khả năng hoạt động tự do trên thế giới, đưa ra quyết định của riêng mình và cải thiện quy trình. Anh ấy sẽ phát minh ra một phương tiện giao thông cá nhân rẻ hơn, nhanh hơn và an toàn hơn ô tô.

Những câu hỏi và nhiệm vụ này, có vẻ khó đối với chúng tôi, đối với hệ thống siêu thông minh sẽ có vẻ như thể ai đó yêu cầu cải thiện tình huống "Tôi có một chiếc bút chì rơi khỏi bàn", trong đó bạn chỉ cần nhặt nó lên và đặt lại.

Eliezer Yudkowsky, một chuyên gia trí tuệ nhân tạo người Mỹ, đã lưu ý:

Có rất nhiều nhà khoa học, nhà phát minh và doanh nhân thiếu kiên nhẫn đã chọn khu vực thoải mái tự tin trên bàn của chúng ta, nhưng để đi bộ đến điều tốt nhất trong thế giới tốt nhất có thể này, chúng ta chỉ cần một người hướng dẫn.

Ray Kurzweil là người xung quanh. Một số thần tượng ý tưởng của mình, một số coi thường. Một số đứng giữa - Douglas Hofstadter, khi thảo luận về ý tưởng trong các cuốn sách của Kurzweil, đã nhận xét một cách hùng hồn rằng "giống như việc bạn lấy rất nhiều thức ăn ngon và một ít phân chó, rồi trộn tất cả lại với nhau khiến bạn không thể phân biệt được đâu là tốt. và cái gì là xấu.”

Cho dù bạn có thích ý tưởng của anh ấy hay không, bạn không thể lướt qua chúng mà không có chút hứng thú nào. Anh ấy bắt đầu phát minh ra mọi thứ khi còn là một thiếu niên, và trong những năm sau đó đã phát minh ra một số thứ quan trọng, bao gồm máy quét hình phẳng đầu tiên, máy quét chuyển văn bản thành giọng nói đầu tiên, bộ tổng hợp âm nhạc nổi tiếng Kurzweil (đàn piano điện thực sự đầu tiên) và đầu tiên nhận dạng giọng nói thành công về mặt thương mại. Ông cũng là tác giả của năm cuốn sách nổi tiếng. Kurzweil được đánh giá cao nhờ những dự đoán táo bạo và thành tích của ông khá tốt - vào cuối những năm 80, khi Internet vẫn còn sơ khai, ông đã gợi ý rằng đến những năm 2000, Web sẽ trở thành một hiện tượng toàn cầu. Tạp chí Phố Wall gọi Kurzweil là "thiên tài không ngừng nghỉ", Forbes là "cỗ máy tư duy toàn cầu", Inc. Tạp chí - "người thừa kế hợp pháp của Edison", Bill Gates - "người giỏi nhất trong số những người dự đoán tương lai của trí tuệ nhân tạo." Vào năm 2012, người đồng sáng lập Google, Larry Page đã thuê Kurzweil làm CTO. Năm 2011, anh đồng sáng lập Đại học Singularity, do NASA tổ chức và được tài trợ một phần bởi Google.

Tiểu sử của anh ấy quan trọng. Khi Kurzweil nói về tầm nhìn của anh ấy về tương lai, nghe có vẻ như một người điên rồ, nhưng điều thực sự điên rồ về điều đó là anh ấy còn lâu mới điên - anh ấy là một người cực kỳ thông minh, có học thức và lành mạnh. Bạn có thể nghĩ rằng anh ấy đã sai trong những dự đoán của mình, nhưng anh ấy không phải là một kẻ ngốc. Những dự đoán của Kurzweil được nhiều chuyên gia về "vùng thoải mái" là Peter Diamandis và Ben Herzel chia sẻ. Đây là những gì sẽ xảy ra, theo ý kiến của anh ấy.

Dòng thời gian

Kurzweil tin rằng máy tính sẽ đạt đến cấp độ trí tuệ nhân tạo chung (AGI) vào năm 2029 và đến năm 2045, chúng ta sẽ không chỉ có trí tuệ siêu phàm nhân tạo mà còn có một thế giới hoàn toàn mới - thời điểm của cái gọi là điểm kỳ dị. Dòng thời gian AI của ông vẫn bị coi là phóng đại thái quá, nhưng trong 15 năm qua, sự phát triển nhanh chóng của các hệ thống AI thu hẹp (AI) đã khiến nhiều chuyên gia đào tẩu sang Kurzweil. Những dự đoán của ông vẫn tham vọng hơn so với cuộc thăm dò của Bostrom (ARI vào năm 2040, ASI vào năm 2060), nhưng không nhiều.

Theo Kurzweil, ba cuộc cách mạng đồng thời trong công nghệ sinh học, công nghệ nano và quan trọng hơn là AI đang dẫn đến điểm kỳ dị của năm 2045. Nhưng trước khi chúng ta tiếp tục - và công nghệ nano đang gắn bó chặt chẽ với trí tuệ nhân tạo - chúng ta hãy dành một phút cho công nghệ nano.

Đôi lời về công nghệ nano

Công nghệ nano là những gì chúng ta thường gọi là công nghệ xử lý việc thao túng vật chất trong phạm vi 1-100 nanomet. Một nanomet là một phần tỷ của mét, hoặc một phần triệu của milimét; trong phạm vi 1-100 nanomet, bạn có thể chứa virus (đường kính 100 nm), DNA (rộng 10 nm), phân tử huyết sắc tố (5 nm), glucose (1 nm), v.v. Nếu công nghệ nano trở thành của chúng ta, thì bước tiếp theo sẽ là thao tác với các nguyên tử riêng lẻ, chúng chỉ nhỏ hơn một bậc độ lớn (~.1 nm).

Để hiểu mọi người gặp vấn đề ở đâu khi cố gắng thao túng vật chất ở quy mô như vậy, chúng ta hãy nhanh chóng chuyển sang quy mô lớn hơn. Trạm vũ trụ quốc tế nằm cách Trái đất 481 km. Nếu con người là những người khổng lồ và va vào ISS bằng đầu, họ sẽ lớn gấp 250 lần so với hiện tại. Nếu bạn phóng đại thứ gì đó từ 000 đến 1 nanomet theo hệ số 100, bạn sẽ có được 250 cm. Công nghệ nano tương đương với việc một người ở trên cao như ISS, cố gắng kiểm soát những thứ có kích thước bằng hạt cát hoặc nhãn cầu. Để đạt được cấp độ tiếp theo - điều khiển các nguyên tử riêng lẻ - người khổng lồ sẽ phải định vị cẩn thận các vật thể có đường kính 000/2,5 milimét. Người thường sẽ cần kính hiển vi để nhìn thấy chúng.

Richard Feynman lần đầu tiên nói về công nghệ nano vào năm 1959. Sau đó, ông nói: “Các nguyên tắc vật lý, theo như tôi có thể nói, không chống lại khả năng kiểm soát mọi thứ từ nguyên tử này sang nguyên tử khác. Về nguyên tắc, một nhà vật lý có thể tổng hợp bất kỳ chất hóa học nào được viết ra bởi một nhà hóa học. Làm sao? Bằng cách đặt các nguyên tử ở nơi mà nhà hóa học nói để tạo ra một chất." Đây là tất cả sự đơn giản. Nếu bạn biết cách di chuyển các phân tử hoặc nguyên tử riêng lẻ, bạn có thể làm bất cứ điều gì.

Công nghệ nano đã trở thành một lĩnh vực khoa học nghiêm túc vào năm 1986 khi kỹ sư Eric Drexler giới thiệu nền tảng của nó trong cuốn sách nổi tiếng Machines of Creation của ông, tuy nhiên bản thân Drexler tin rằng những ai muốn tìm hiểu thêm về những ý tưởng hiện tại trong công nghệ nano nên đọc cuốn sách năm 2013 của ông "Full Abundance" (Radical phong phú).

Đôi lời về "chất nhờn xám"

Chúng tôi đi sâu vào công nghệ nano. Trong đó, chủ đề về "chất xám" là một trong những chủ đề khó chịu nhất trong lĩnh vực công nghệ nano, không thể bỏ qua. Trong các phiên bản cũ hơn của lý thuyết công nghệ nano, phương pháp lắp ráp nano đã được đề xuất, liên quan đến việc tạo ra hàng nghìn tỷ robot nano nhỏ có thể phối hợp với nhau để tạo ra thứ gì đó. Một cách để tạo ra hàng nghìn tỷ nanorobot là tạo ra một loại có thể tự tái tạo, nghĩa là từ một - hai, từ hai - bốn, v.v. Vài nghìn tỷ nanorobot sẽ xuất hiện trong một ngày. Đó là sức mạnh của sự tăng trưởng theo cấp số nhân. Thật buồn cười phải không?

Thật buồn cười, nhưng chính xác cho đến khi nó dẫn đến ngày tận thế. Vấn đề là sức mạnh của sự tăng trưởng theo cấp số nhân, giúp tạo ra một nghìn tỷ nanobot khá thuận tiện, lại khiến việc tự sao chép trở thành một điều đáng sợ về lâu dài. Điều gì sẽ xảy ra nếu hệ thống gặp sự cố và thay vì dừng sao chép ở mức vài nghìn tỷ, các nanobot tiếp tục nhân lên? Nếu toàn bộ quá trình này phụ thuộc vào carbon thì sao? Sinh khối của Trái đất chứa 10^45 nguyên tử carbon. Một nanobot sẽ phải có thứ tự 10^6 nguyên tử carbon, vì vậy 10^39 nanobot sẽ nuốt chửng tất cả sự sống trên Trái đất chỉ sau 130 lần lặp lại. Một đại dương nanobot ("chất nhờn màu xám") sẽ tràn ngập hành tinh. Các nhà khoa học cho rằng nanobots có thể tái tạo trong 100 giây, điều đó có nghĩa là một sai lầm đơn giản có thể giết chết tất cả sự sống trên Trái đất chỉ trong 3,5 giờ.

Nó có thể còn tồi tệ hơn nếu bàn tay của những kẻ khủng bố và các chuyên gia bất lợi chạm tới công nghệ nano. Họ có thể tạo ra vài nghìn tỷ nanobot và lập trình để chúng âm thầm lan rộng khắp thế giới trong vài tuần. Sau đó, chỉ cần nhấn nút, chỉ trong 90 phút, họ sẽ ăn sạch mọi thứ, không có cơ hội.

Mặc dù câu chuyện kinh dị này đã được thảo luận rộng rãi trong nhiều năm, nhưng tin tốt là nó chỉ là một câu chuyện kinh dị. Eric Drexler, người đã đặt ra thuật ngữ "grey goo", đã nói vào một ngày khác: "Mọi người thích những câu chuyện đáng sợ, và câu chuyện này thuộc thể loại truyện kinh dị về thây ma. Bản thân ý tưởng này đã ăn não rồi.

Một khi chúng ta đi đến tận cùng của công nghệ nano, chúng ta có thể sử dụng nó để tạo ra các thiết bị kỹ thuật, quần áo, thực phẩm, sản phẩm sinh học - tế bào máu, thuốc chống vi-rút và ung thư, mô cơ, v.v. - bất cứ thứ gì. Và trong một thế giới sử dụng công nghệ nano, giá thành của vật liệu sẽ không còn bị ràng buộc bởi sự khan hiếm hoặc mức độ phức tạp của quy trình sản xuất, mà là mức độ phức tạp của cấu trúc nguyên tử. Trong thế giới công nghệ nano, một viên kim cương có thể trở nên rẻ hơn một cục tẩy.

Chúng tôi thậm chí còn chưa thân thiết. Và không hoàn toàn rõ ràng liệu chúng ta đánh giá thấp hay đánh giá quá cao sự phức tạp của con đường này. Tuy nhiên, mọi thứ đi vào thực tế là công nghệ nano không còn xa nữa. Kurzweil gợi ý rằng đến những năm 2020 chúng ta sẽ có chúng. Các chính phủ trên thế giới biết rằng công nghệ nano có thể hứa hẹn một tương lai vĩ đại, và do đó họ đang đầu tư nhiều tỷ đô la vào chúng.

Chỉ cần tưởng tượng loại khả năng mà một máy tính siêu thông minh sẽ có được nếu nó có một bộ lắp ráp kích thước nano đáng tin cậy. Nhưng công nghệ nano là ý tưởng của chúng tôi và chúng tôi đang cố gắng thực hiện nó, điều đó thật khó đối với chúng tôi. Điều gì sẽ xảy ra nếu đối với hệ thống ASI, chúng sẽ chỉ là một trò đùa và chính ASI sẽ tạo ra những công nghệ mạnh hơn gấp nhiều lần so với bất kỳ thứ gì mà chúng ta thậm chí có thể tưởng tượng về nguyên tắc? Chúng tôi đồng ý: không ai có thể đoán được siêu trí tuệ nhân tạo sẽ có khả năng gì? Có ý kiến cho rằng bộ não của chúng ta không thể dự đoán được dù chỉ là điều tối thiểu nhất về những gì sẽ xảy ra.

AI có thể làm gì cho chúng ta?

Được trang bị siêu trí tuệ và tất cả các công nghệ mà siêu trí tuệ có thể tạo ra, ASI có thể sẽ giải quyết được tất cả các vấn đề của nhân loại. Sự nóng lên toàn cầu? Trước tiên, CSI sẽ ngừng phát thải carbon dioxide bằng cách đưa ra một loạt các cách hiệu quả để tạo ra năng lượng không sử dụng nhiên liệu hóa thạch. Sau đó, anh ấy sẽ nghĩ ra một cách hiệu quả, sáng tạo để loại bỏ lượng CO2 dư thừa ra khỏi khí quyển. Ung thư và các bệnh khác? Không thành vấn đề - chăm sóc sức khỏe và y học sẽ thay đổi theo những cách không thể tưởng tượng được. Nạn đói thế giới? ISI sẽ sử dụng công nghệ nano để tạo ra thịt giống hệt với thịt thật tự nhiên.

Công nghệ nano sẽ có thể biến một đống rác thành một thùng thịt tươi hoặc thực phẩm khác (thậm chí không ở dạng thông thường - hãy tưởng tượng một khối táo khổng lồ) và phân phối tất cả thực phẩm này trên khắp thế giới bằng hệ thống vận chuyển tiên tiến. Tất nhiên, điều này sẽ rất tốt cho những con vật không còn phải chết vì thức ăn nữa. ASI cũng có thể làm nhiều việc khác, chẳng hạn như cứu các loài có nguy cơ tuyệt chủng hoặc thậm chí mang về những loài đã tuyệt chủng từ DNA được bảo tồn. ASI có thể giải quyết các vấn đề kinh tế vĩ mô khó khăn nhất của chúng ta—các cuộc tranh luận kinh tế khó khăn nhất của chúng ta, các câu hỏi về đạo đức và triết học, thương mại thế giới—tất cả những vấn đề này sẽ trở nên rõ ràng một cách đau đớn đối với ASI.

Nhưng có một điều đặc biệt mà ISI có thể làm cho chúng ta. Lôi cuốn và trêu chọc sẽ thay đổi mọi thứ: ASI có thể giúp chúng ta đối phó với tỷ lệ tử vong. Dần dần hiểu được khả năng của AI, có thể bạn sẽ xem xét lại mọi ý tưởng của mình về cái chết.

Không có lý do gì để quá trình tiến hóa kéo dài tuổi thọ của chúng ta ngoài hiện tại. Nếu chúng ta sống đủ lâu để sinh nở và nuôi nấng con cái đến mức chúng có thể tự lo cho mình, thì quá trình tiến hóa là đủ. Từ quan điểm tiến hóa, hơn 30 năm là đủ để phát triển và không có lý do gì để đột biến kéo dài tuổi thọ và giảm giá trị của chọn lọc tự nhiên. William Butler Yeats gọi giống loài chúng ta là "linh hồn gắn liền với một con vật sắp chết." Không vui lắm.

Và vì tất cả chúng ta đều có lúc chết nên chúng ta sống với suy nghĩ rằng cái chết là không thể tránh khỏi. Chúng tôi nghĩ về sự già đi theo thời gian - tiếp tục tiến lên và không thể dừng quá trình này lại. Nhưng ý nghĩ về cái chết thật nguy hiểm: bị nó bắt giữ, chúng ta quên mất sự sống. Richard Feynman đã viết:

“Có một điều tuyệt vời trong sinh học: trong khoa học này không có gì nói lên sự cần thiết của cái chết. Nếu chúng ta muốn tạo ra một cỗ máy chuyển động vĩnh cửu, chúng ta nhận ra rằng chúng ta đã khám phá đủ các định luật vật lý chỉ ra rằng điều này là không thể hoặc các định luật đó sai. Nhưng không có gì trong sinh học cho thấy cái chết là không thể tránh khỏi. Điều này khiến tôi nghĩ rằng nó không phải là điều không thể tránh khỏi, và vấn đề chỉ là thời gian trước khi các nhà sinh vật học khám phá ra nguyên nhân của vấn đề này, căn bệnh phổ biến khủng khiếp này, nó sẽ được chữa khỏi.

Thực tế là lão hóa không liên quan gì đến thời gian. Lão hóa là sự hao mòn của các chất liệu vật chất của cơ thể. Các bộ phận của ô tô cũng xuống cấp - nhưng sự lão hóa này có phải là điều không thể tránh khỏi? Nếu bạn sửa xe khi các bộ phận bị hao mòn, nó sẽ tồn tại mãi mãi. Cơ thể con người không khác, chỉ phức tạp hơn.

Kurzweil nói về các nanobot thông minh, được kết nối Wi-Fi trong máu có thể thực hiện vô số nhiệm vụ đối với sức khỏe con người, bao gồm thường xuyên sửa chữa hoặc thay thế các tế bào bị hao mòn ở bất kỳ bộ phận nào của cơ thể. Nếu quá trình này được cải thiện (hoặc một giải pháp thay thế được đề xuất bởi các ASI thông minh hơn), thì nó không chỉ giữ cho cơ thể khỏe mạnh mà còn có thể đảo ngược quá trình lão hóa. Sự khác biệt giữa cơ thể của một người 60 tuổi và một người 30 tuổi nằm ở một số vấn đề về thể chất có thể được khắc phục bằng công nghệ phù hợp. ASI có thể chế tạo một cỗ máy mà một người sẽ vào ở tuổi 60 và thoát ra ở tuổi 30.

Ngay cả một bộ não suy thoái cũng có thể được đổi mới. ASI chắc chắn sẽ biết cách làm điều này mà không ảnh hưởng đến dữ liệu não bộ (tính cách, ký ức, v.v.). Một cụ ông 90 tuổi bị thoái hóa não hoàn toàn có thể được đào tạo lại, nâng cấp và quay trở lại sự nghiệp ban đầu của mình. Nó có vẻ vô lý, nhưng cơ thể là một số nguyên tử, và ASI chắc chắn có thể điều khiển chúng một cách dễ dàng, bất kỳ cấu trúc nguyên tử nào. Nó không phải là tất cả vô lý.

Kurzweil cũng tin rằng các vật liệu nhân tạo sẽ ngày càng tích hợp nhiều hơn vào cơ thể khi thời gian trôi qua. Đối với những người mới bắt đầu, các cơ quan có thể được thay thế bằng các phiên bản máy móc cực kỳ tiên tiến sẽ tồn tại mãi mãi và không bao giờ hỏng hóc. Sau đó, chúng ta có thể thiết kế lại hoàn toàn cơ thể, thay thế các tế bào hồng cầu bằng các nanobot hoàn hảo tự di chuyển, loại bỏ hoàn toàn nhu cầu về tim. Chúng tôi cũng có thể cải thiện khả năng nhận thức của mình, bắt đầu suy nghĩ hàng tỷ nhanh hơn và truy cập tất cả thông tin có sẵn cho nhân loại thông qua đám mây.

Khả năng đạt đến những chân trời mới sẽ thực sự vô hạn. Mọi người đã cố gắng mang lại cho tình dục một mục đích mới, họ làm điều đó vì niềm vui chứ không chỉ để sinh sản. Kurzweil nghĩ rằng chúng ta có thể làm điều tương tự với thức ăn. Nanobots có thể cung cấp dinh dưỡng lý tưởng trực tiếp đến các tế bào của cơ thể, cho phép các chất không lành mạnh đi xuyên qua cơ thể. Nhà lý thuyết công nghệ nano Robert Freitas đã phát triển một chất thay thế cho các tế bào máu, khi được đưa vào cơ thể con người, có thể cho phép anh ta không thở trong 15 phút - và người đàn ông này đã nghĩ ra. Hãy tưởng tượng khi ISI có được sức mạnh.

Cuối cùng, Kurzweil tin rằng con người sẽ đạt đến điểm mà họ trở nên hoàn toàn nhân tạo; thời điểm mà chúng ta sẽ xem xét các vật liệu sinh học và nghĩ về việc chúng ta nguyên thủy như thế nào; thời điểm mà chúng ta sẽ đọc về những giai đoạn đầu của lịch sử loài người, kinh ngạc trước việc vi trùng, tai nạn, bệnh tật hay tuổi già có thể giết chết một người trái với ý muốn của họ như thế nào. Cuối cùng, mọi người sẽ vượt qua sinh học của chính họ và trở thành vĩnh cửu - đó là con đường về phía hạnh phúc của nhật ký cân bằng, mà chúng ta đã nói đến ngay từ đầu. Và những người tin vào điều này cũng chắc chắn rằng một tương lai như vậy đang chờ đợi chúng ta rất, rất sớm.

Bạn chắc chắn sẽ không ngạc nhiên khi những ý tưởng của Kurzweil bị chỉ trích nặng nề. Điểm kỳ dị của anh ta vào năm 2045 và cuộc sống vĩnh cửu sau đó cho con người được mệnh danh là "sự thăng thiên của mọt sách" hay "sự sáng tạo thông minh của con người với chỉ số IQ là 140". Những người khác đặt câu hỏi về khung thời gian lạc quan, hiểu biết về cơ thể và bộ não con người, nhắc nhở về định luật Moore, vẫn chưa biến mất. Đối với mỗi chuyên gia tin vào ý tưởng của Kurzweil, có ba người cho rằng anh ta sai.

Nhưng điều thú vị nhất về điều này là hầu hết các chuyên gia không đồng ý với anh ta, nói chung, không nói rằng điều này là không thể. Thay vì nói "vô nghĩa, điều này sẽ không bao giờ xảy ra", họ nói điều gì đó như "tất cả điều này sẽ xảy ra nếu chúng ta đến được ASI, nhưng đó là điểm mấu chốt." Bostrom, một trong những chuyên gia AI được công nhận cảnh báo về sự nguy hiểm của AI, cũng thừa nhận:

“Sẽ khó có vấn đề nào mà trí tuệ siêu việt không thể giải quyết, thậm chí không thể giúp chúng ta giải quyết. Bệnh tật, nghèo đói, hủy hoại môi trường, đủ loại đau khổ - tất cả những điều này siêu trí tuệ với sự trợ giúp của công nghệ nano có thể giải quyết trong giây lát. Ngoài ra, siêu trí tuệ có thể mang lại cho chúng ta tuổi thọ không giới hạn bằng cách ngăn chặn và đảo ngược quá trình lão hóa bằng cách sử dụng thuốc nano hoặc khả năng tải chúng ta lên đám mây. Siêu trí tuệ cũng có thể tạo cơ hội cho sự gia tăng vô hạn về năng lực trí tuệ và cảm xúc; anh ấy có thể hỗ trợ chúng ta tạo ra một thế giới mà chúng ta sẽ sống trong niềm vui và sự hiểu biết, tiếp cận lý tưởng của mình và thường xuyên hiện thực hóa ước mơ của mình.

Tuy nhiên, đây là trích dẫn từ một trong những người chỉ trích Kurzweil, thừa nhận rằng tất cả những điều này đều có thể thực hiện được nếu chúng ta quản lý để tạo ra một ASI an toàn. Kurzweil đã định nghĩa một cách đơn giản siêu trí tuệ nhân tạo sẽ là gì nếu nó trở nên khả thi. Và nếu anh ta là một vị thần tốt.

Lời chỉ trích rõ ràng nhất đối với những người ủng hộ vùng thoải mái là họ có thể sai lầm nghiêm trọng về tương lai của ASI. Trong cuốn sách Điểm kỳ dị của mình, Kurzweil đã dành 20 trang trong tổng số 700 trang cho các mối đe dọa ASI tiềm ẩn. Câu hỏi không phải là khi nào chúng ta đạt được ASI, câu hỏi là động lực của anh ấy sẽ là gì. Kurzweil trả lời câu hỏi này một cách thận trọng: “ASI xuất hiện từ nhiều nỗ lực khác nhau và sẽ được tích hợp sâu vào cơ sở hạ tầng của nền văn minh của chúng ta. Trên thực tế, nó sẽ được tích hợp chặt chẽ vào cơ thể và não bộ của chúng ta. Nó sẽ phản ánh các giá trị của chúng tôi vì nó sẽ là một với chúng tôi.”

Nhưng nếu câu trả lời là, tại sao rất nhiều người thông minh trên thế giới này lại lo lắng về tương lai của trí tuệ nhân tạo? Tại sao Stephen Hawking nói rằng sự phát triển của ASI "có thể đồng nghĩa với sự kết thúc của loài người"? Bill Gates nói rằng ông "không hiểu những người không quan tâm" về điều đó. Elon Musk lo sợ rằng chúng ta đang "triệu hồi một con quỷ". Tại sao nhiều chuyên gia coi ASI là mối đe dọa lớn nhất đối với nhân loại?

Chúng ta sẽ nói về điều này vào lần sau.

Phỏng theo waitbutwhy.com, biên dịch bởi Tim Urban. Bài viết sử dụng tư liệu từ các tác phẩm của Nick Bostrom, James Barratt, Ray Kurzweil, Jay Niels-Nielsson, Steven Pinker, Vernor Vinge, Moshe Vardy, Russ Roberts, Stuart Armstrog và Kai Sotal, Susan Schneider, Stuart Russell và Peter Norvig, Theodore Modis, Gary Marcus, Karl Schulman, John Searle, Jaron Lanier, Bill Joy, Kevin Kelly, Paul Allen, Stephen Hawking, Kurt Andersen, Mitch Kapor, Ben Goertzel, Arthur C. Clarke, Hubert Dreyfus, Ted Greenwald, Jeremy Howard.

tin tức